これまでディープラーニングといえば、画像や文字の「認識」や「分類」に使われるイメージが強いですよね。

しかし最近では、「新しいデータを生み出す」ことに応用されるケースが増えています。

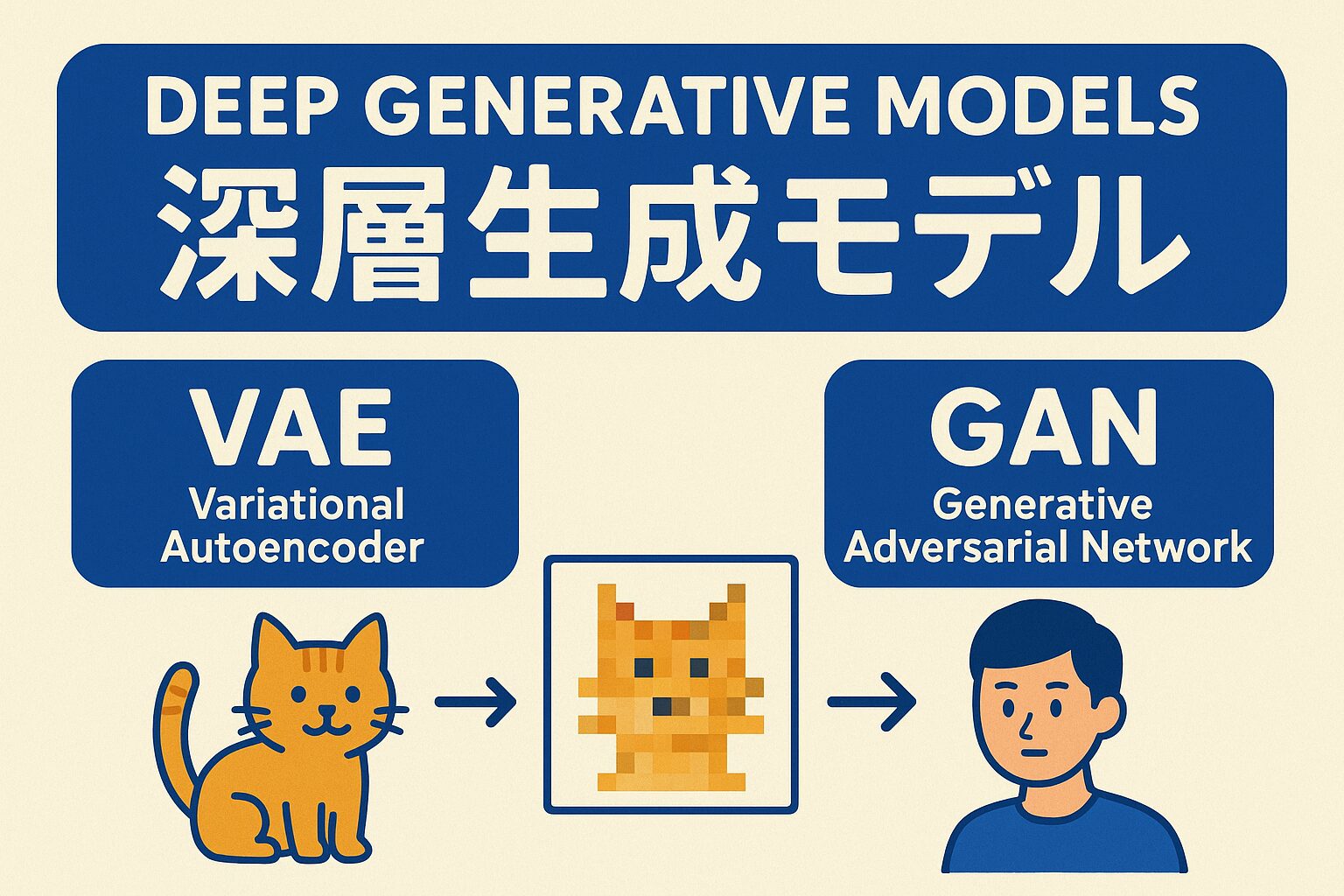

このようにデータを生成することを目的とするAIモデルを、**深層生成モデル(Deep Generative Model)**と呼びます。

深層生成モデルの特徴は、元のデータの分布を学習し、それと似たような新しいデータを自ら作り出せる点にあります。

たとえば猫の写真を大量に学習したモデルは、実在しない“架空の猫”の画像を自然に生成できるのです。

代表的な2つの手法

1. VAE(Variational Autoencoder)

VAEは、確率的な潜在変数モデルを使ってデータの“本質的な特徴”を学習します。

その結果、学習した潜在空間(データの構造的な写像)から、まったく新しいデータを生成できるようになります。

VAEは比較的安定して学習できる点が特徴で、画像の生成だけでなく、音声や文章生成にも活用されています。

2. GAN(Generative Adversarial Network)

GANは、**「生成器(Generator)」と「識別器(Discriminator)」**という2つのネットワークを使います。

-

生成器:本物のようなデータを作ろうとする

-

識別器:それが本物か偽物かを見抜こうとする

この2つが競い合いながら学習を進めることで、最終的に「本物と区別がつかないほどリアルな画像」を生み出せるようになります。

GANは、その革新性と高い表現力でAI研究に大きなインパクトを与えました。

GANの発展形モデル

GANには多くの改良版が提案されています。代表的なものをいくつか紹介します。

■ DCGAN(Deep Convolutional GAN)

畳み込みニューラルネットワーク(CNN)を取り入れたことで、高解像度で安定した画像生成を実現。

GANの実用化を大きく前進させたモデルです。

■ Pix2Pix

**画像から画像への変換(Image-to-Image Translation)**を目的とするモデルです。

たとえば、

■ CycleGAN

Pix2Pixとは異なり、対応するペア画像を必要としないのが特徴。

「馬をシマウマに」「夏の風景を冬に」といったスタイル変換を学習だけで実現できます。

アートや写真編集の分野でも注目されています。

まとめ

深層生成モデルは、AIが「理解する」だけでなく「創造する」時代を切り開いた技術です。

VAEやGANの登場によって、AIは絵を描き、音を作り、文章を紡ぐ存在へと進化しました。

今後は、創作支援やデザイン、医療シミュレーションなど、**“AIが生み出す世界”**がさらに広がっていくでしょう。

深層生成モデル(Deep Generative Models)は、ディープラーニングが文字や物体の認識といった分類タスクに応用されるだけでなく、データの生成タスクにも活用されている。生成モデルの目的は、元の画像データと似たような新しいデータを生成することであり、入力データの分布を学習する点に特徴がある。

深層生成モデルの代表的なアプローチとしては、

これらの手法は画像生成をはじめ、音声や文章の生成など幅広い分野で成果を上げている。

GANはジェネレータとディスクリミネータで構成される、GANは2種類のネットワークを競い合わせることで、最終的に本物と見分けがつかないような新しい画像を生成する、GANを発展させた手法としてとDCGANとPix2PixとCycleGanなどがある

**GAN(Generative Adversarial Network)**は、**ジェネレータ(生成器)とディスクリミネータ(識別器)**という2種類のネットワークから構成される。ジェネレータは本物と見分けがつかないようなデータを生成しようとし、ディスクリミネータは入力が本物か生成データかを識別しようとする。両者を競い合わせて学習を進めることで、最終的に非常にリアルな新しい画像を生成できる。

GANにはさまざまな発展形が提案されており、代表的なものとして以下が挙げられる。

-

DCGAN(Deep Convolutional GAN):畳み込みニューラルネットワークを取り入れることで、高解像度で安定した画像生成を可能にした。

-

Pix2Pix:画像から画像への変換(Image-to-Image Translation)を目的とし、白黒画像をカラー化したり、スケッチから写真風の画像を生成するなどの応用がある。

-

CycleGAN:ペアデータを必要とせず、スタイル変換を可能にする手法。たとえば「馬をシマウマに」「夏の景色を冬に」といった変換が可能。

コメント